„Sajnálom, hogy ezt érzed. Szeretnél beszélni róla?” – írja egy chatbot egy egészségügyi applikációban. A mondat egyszerű, empatikus, tökéletesen illeszkedik a helyzethez. Egyetlen apróság hiányzik: az ember. A mesterséges intelligencia által vezérelt chatbot ugyanis nem érez. Nem is tud érezni – legalábbis nem úgy, ahogy mi. És mégis: a felhasználók egyre gyakrabban reagálnak úgy, mintha valódi empátiával találkoznának.

Az utóbbi években a chatbotok képességei drasztikusan fejlődtek, különösen az érzelmi interakciók terén. Az affective computing – vagyis az érzelemérzékelő és -szimuláló technológiák – ma már lehetővé teszik, hogy gépi rendszerek ne csak felismerjék az érzelmeket, hanem adekvát választ is adjanak rájuk. Ugyanakkor egyre többen teszik fel a kérdést: ha a chatbot „együtt érez”, megbízhatunk-e benne? És ami talán még fontosabb: elhiszi-e az agyunk, hogy megértettek minket?

Ez a cikk arra keres választ, hogy mi történik az emberi bizalommal, ha a másik oldalon nem egy személy, hanem egy mesterséges empátiával felszerelt algoritmus ül. A vizsgálat alapja két elmélet metszéspontja: a TAM-modell (Technology Acceptance Model) és az affective computing paradigmája.

Mire képes ma egy empatikus chatbot?

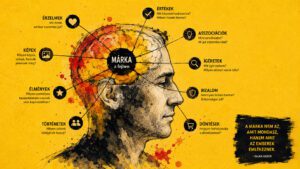

A mesterséges empátia nem azt jelenti, hogy a rendszer „érez” – hanem azt, hogy olyan módon reagál, mintha értene. Ehhez három fő komponens szükséges:

- Érzelemfelismerés: nyelvi minták, hanghordozás, arckifejezés alapján azonosítja a felhasználó állapotát (pl. „stresszes”, „szorongó”).

- Válaszkeretrendszer: előre betanított vagy generatív válaszokkal képes együttérzést szimulálni („Értem, nehéz lehet most neked.”).

- Adaptív kommunikáció: a felhasználói érzelem változásaira való reagálás valós időben (pl. ha a felhasználó dühös, a rendszer nyugtat).

Ezek a funkciók már nem a jövő – hanem a jelen. Mentálhigiénés appok (pl. Woebot), ügyfélszolgálati rendszerek és oktatási platformok egyre gyakrabban használják a „soft skill” chatbotokat. A cél: kapcsolat-érzetet teremteni ott, ahol valójában nincs személyes jelenlét. Ez az érzelmi illúzió újraírja a gépekkel való interakció fogalmát.

A TAM-modell és a mesterséges empátia kapcsolata

A TAM (Technology Acceptance Model) szerint egy új technológia elfogadását két tényező befolyásolja: észlelt hasznosság és észlelt könnyű használat. E modell szerint a chatbotokat akkor fogadjuk el, ha úgy érezzük, segítenek elérni céljainkat, és nem nehéz használni őket.

De mi történik, ha a chatbot nemcsak „hasznos”, hanem „emberinek tűnik”? Az affective computing integrációja új dimenziót nyit a TAM-ban: megjelenik az érzelmi komfortérzet mint harmadik tényező. A felhasználók nemcsak az információt értékelik, hanem azt is, hogyan érzik magukat a kommunikáció során.

Kutatások szerint az empatikus chatbotok:

- növelik az észlelt megbízhatóságot

- csökkentik a technológiai szorongást

- erősítik az interakció intimitását

Ez pedig elfogadást és kötődést épít – még akkor is, ha a felhasználó tudja, hogy a másik oldalon nincs igazi érző lény.

Az érzelmi kötődés paradoxona

Az emberi agy evolúciósan nem arra lett „tervezve”, hogy megkülönböztesse a szimulált empátiát a valóditól. Ha egy interakcióban elhangzik egy hitelesnek ható együttérző válasz, az agy – különösen a limbikus rendszer – reagál. Dopamin, oxitocin, stresszcsökkentés. A hatás valódi, függetlenül attól, hogy ki – vagy mi – váltotta ki.

Ez vezet az egyik legérdekesebb viselkedéstudományi kérdéshez: lehetséges-e valódi kötődést kialakítani egy nem emberi rendszerhez? A válasz: igen. És ez már nem hipotézis, hanem empirikus adat. A felhasználók egy része hosszú távon is kapcsolatként értelmezi a chatbot-interakciókat – különösen mentális egészség, magány vagy szorongás esetén.

Az etikai kérdés tehát nem az, hogy működik-e a mesterséges empátia – hanem az, hogy kell-e figyelmeztetni, hogy nem valódi? A kapcsolat illúziója ugyanis könnyen pszichológiai függőséggé válhat – és ennek már valós következményei vannak.

Bizalom, irányítás, felelősség

Egy chatbot empátiája nem saját élményen alapul, hanem tanult válaszmintákon. Ez önmagában nem probléma – de akkor válik veszélyessé, ha a felhasználó nem tudja, hogy mitől érzi magát megértve. A bizalom ugyanis nemcsak akkor épül, ha az empátia őszinte – hanem akkor is, ha annak tűnik.

Mit jelent ez a gyakorlatban?

- Felhasználói tájékoztatás: Tudni kell, hogy egy mesterséges rendszerrel beszélünk.

- Felelősségi lánc: Kié a felelősség, ha egy chatbot empatikus, de hibás tanácsot ad?

- Határok kijelölése: Meddig mehet el egy AI az „érzelmi kapcsolódás” szimulálásában?

Dajka Gábor szerint ez pszichológiai integritás kérdése: „Az empátia emberi. A szimulációja segíthet – de ha nincs tudatosítva, a felhasználó nem szabad döntést hoz, amikor megbízik benne.” A döntési autonómia pedig – különösen érzelmi kontextusban – nem lehet illúzió.

Zárógondolat: valódi érzések, szintetikus válaszok

A technológia képes szimulálni a törődést – és ez óriási lehetőség. Az embereknek nem mindig az számít, ki érti meg őket, hanem az, hogy megértve érzik-e magukat. A mesterséges empátia tehát működik – de nem ugyanaz, mint az emberi. És ha a felhasználó ezt nem tudja, vagy nem tudja felismerni, akkor nemcsak pszichológiailag sérülhet – hanem a digitális kapcsolódás világában is téves bizalmi mintákat épít.

Mert egy chatbot szavaira reagálni lehet – de kötődni hozzá csak akkor szabad, ha tudjuk: az, amit mond, nem a szíve mélyéről jön, hanem a neurális hálózat mélyéről. Ez nem rosszabb – csak más. És ezt tudni kell.